随着AI→IDC需求传导链条的淤堵逐渐被疏通,被挤压的需求即将持续释放,中国IDC市场正在迎来新一轮增长周期——鼎晖投资长期深耕数据中心行业,已累计完成超50亿元人民币的投资,并于2020年10月成功设立国内第 一支人民币数据中心专项基金。本文为鼎晖团队对数据中心行业近况的最新观察与趋势研究。

在当下最令人瞩目的AI产业中,一条朴素的商业规律再次得到验证:在淘金热潮中,那些为淘金者提供必要工具的“卖铲人”,往往能够占据先机,成为最 大的受益者。

2022年11月,大语言模型ChatGPT-3.5震撼发布,也标志着新一轮AI淘金竞赛的开启。在这场竞赛中,智算服务器作为不可或缺的“铲子”,为大模型的发展提供了强大的算力支持,这也使得铲子的生产商们——如研发出H系列、B系列高性能GPU芯片的英伟达——成功抓住了市场先机,实现了业绩爆发。

若进一步挖掘这一产业链,会发现除了直接生产“铲子”的企业外,还有一个重要角色在这场竞赛中扮演着举足轻重的作用——数据中心(IDC)。它们如同高效运转的“运输车队”,负责将智算服务器这一关键资源安全、高效地送达每一位淘金者手中。

他山之石:美国算力需求激增,IDC市场“一柜难求”

先来看几组美国的数据:

1. 模型参数量:1.8万亿→52万亿

从GPT-3到GPT-4再到GPT-5,每一代模型的参数量都增长了十倍以上。目前GPT-4的参数量约为1.8万亿,而GPT-5的参数量预计将再增长近30倍,达到52万亿。

2. GPU卡:2.5万卡→15万卡

模型参数量的增加直接带动了算力(GPU卡)需求的大幅增长。为了训练GPT-5,OpenAI搭建了至少5万张H100(其运算能力约等于15万张A100)的集群,而在GPT-4时期,耗用的A100数量仅为2.5万张。

3. 资本开支:1,475亿美元→2,100亿美元

公开数据显示,2023年美国Top4云厂商巨头(微软、谷歌、亚马逊、meta)资本开支约1,475亿美元,其中绝大部分用于AI和云计算领域。截至2024年8月,彭博一致预期2024年该支出将大幅同比增长40%+至约2,100亿美元。

4. IDC租金:120美元→148美元

服务器的大量采购直接推动了IDC需求的增长,美国IDC机柜租金从每千瓦120美元上涨至148美元,整体上架率飙升至97%,市场呈现“一柜难求”的局面。根据最新预测,美国2027年之前将要交付的存量和在建IDC基本均已被预订完毕。

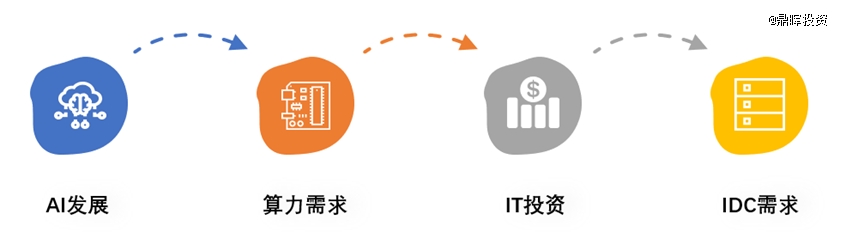

上述数据给我们展现了一个清晰的传导链条,即:AI发展→算力需求→IT投资→IDC需求。

经历过数轮周期、深谙“铲子”理论的海外头部投资机构自然也没有错失这个链条揭示的投资机遇。2023年年中,全球最 大的另类资产管理公司之一的黑石集团,承诺将在3年内向数据中心领域投资80亿美元;仅过一年,2024年9月,黑石领衔的财团又以240亿澳元完成对亚太数据中心运营商AirTrunk的收购,成为全球迄今为止最 大的一笔数据中心并购交易。黑石执行副总裁Jonathan Gray直言:“数据中心是AI革命的基础设施,是有史以来最 好的投资之一。”

海外IDC市场欣欣向荣的背景下,远在大洋彼岸的中国IDC市场走到哪个阶段?

蓄势待发:中国IDC市场需求传导链条逐步启动

对比过去30年中 美数字产业的发展进程,一个有意思的发现是,从传统PC端互联网,到移动互联网,再到产业互联网,中国的行业元年往往晚于美国约2-3年。到了最新的AI时代,我们追赶的节奏已经明显提速,并在IDC这一终端基础设施的需求上初现端倪。

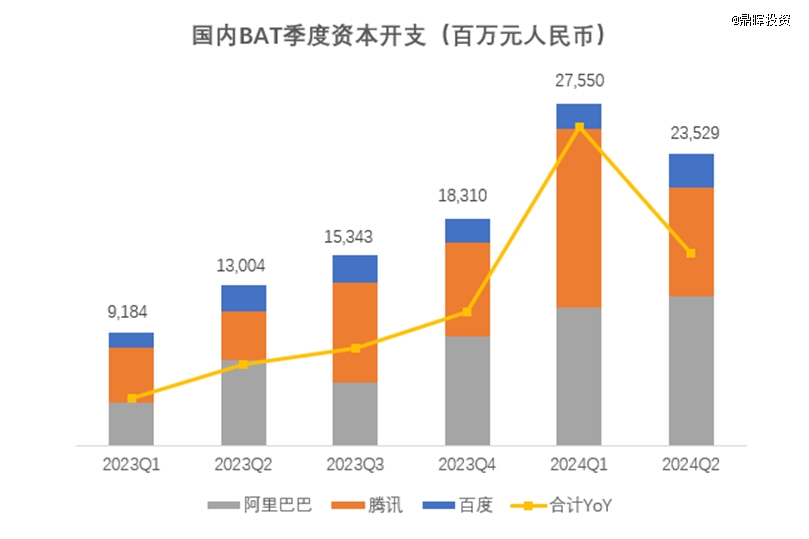

2021年以来,受到疫情及相关政策影响,国内互联网大厂的IT支出受到阶段性抑制,直到AI的技术革新给行业重新注入了强心剂,大厂又纷纷开启了新一轮的“军备竞赛”。由于AI工具的泛用性及应用潜力,叠加大模型训练的算力集群要求,这一轮投资的决心和力度空 前,将2024年Q1国内主要上市互联网企业的资本开支推升到同比3倍,创10年以来新高。

(根据公开资料整理)

很多人可能会问:美国商务部的芯片禁令是不是卡住了我们算力资源的“脖子”?的确,2023年11月生效的这纸禁令使得国内的算力采购滞后了至少6个月时间——但这6个月时间里业界也在持续寻找着芯片替代方案:

据市场调研,不考虑其他品牌及型号的训练及推理芯片,仅英伟达H20+华为910B两款芯片所对应的服务器,预计能为中国IDC市场带来约12万个机柜需求,也使得互联网大厂们对IDC资源呈现出久违的“饥渴”。仅以某一家头部大厂为例,其2024年上半年的IDC订单量超过1GW(对应约10万个高密机柜),已经接近于2023年全年订单总量的2倍,2025年机柜需求量预计还将翻倍。

截至2024年8月,国内经过备案的大模型产品已超过190个,中国AIGC产品的月度访问量在短短半年内增长了120%。在以应用见长的中国,AI对各行各业的渗透速度超出预期。除了大厂以外,我们亦看到金融、自动驾驶、高端制造等行业的IDC需求正在AI技术的推动下不断涌现。

“AI需求可能会迟到,但不会缺席”,随着AI→IDC需求传导链条的淤堵逐渐被疏通,被挤压的需求即将持续释放,中国IDC市场正迎来新一轮增长周期。

产业升级:IDC迈向AIDC的关键变革

除了“量变”之外,AI需求也在给IDC带来质的变化。如何适配新增的AI需求,对于数据中心服务商而言是箭在弦上的课题,对于投资机构而言亦不容忽视。

1. 高密度、大集群需求正在重塑IDC的设计标准

GPU服务器的功率密度远高于传统服务器,且大模型训练对服务器集群属性要求高,这意味IDC需要更大的规模、更高的单机柜设计功率和制冷效率。

2. 核心区域的机房价值仍不可替代

一线城市集中了最广泛的行业客户和中小型AI公司,因此算力云等2B业务更倾向于将服务器部署在核心区位;且随着未来AI推理业务的占比提升,核心区域在网络时延上的优势也将更加凸显。因此算力资源在一线城市等核心区域的部署需求高于市场预期。

3. 服务商的设计规划能力亟待升级

IDC服务商需要深入理解AI业务特点,并揉入IDC前期规划设计之中——例如根据大模型集群特征配置网络架构、通过末端配电的弹性设计灵活匹配不同业务需求等,这对于降低客户算力部署成本以及提高部署效率至关重要。

4. 算力、云计算与IDC的联动将形成独特优势

对于未来大量涌现的中小型AI应用公司,能够提供“机柜+算力+云”一体化解决方案的IDC服务商将具有更大的吸引力,而目前国内能够提供这种综合服务的IDC服务商仍较为稀缺。

结语:投资IDC也是在投资AI及算力的底座

技术与创新界有一条被长期援引的“阿玛拉定律”:“我们总是高估技术的短期收益,而低估技术的长期影响。”

今天的通用人工智能技术尚在襁褓,有人在探索大模型的边界,有人在挖掘算法范式的潜力,有人在等待“超级应用”的诞生……虽然对于AI技术的阶段性共识尚未形成,但我们相信这是一个长期足以全方位影响人类社会的重要新质生产力;作为孵化AI技术的基础设施,IDC行业的发展也同样将面临来自政策、技术的扰动,其供需结构和发展模式亦将持续迭代,但作为投资机构,我们认为投资IDC就是在投资AI及算力的底座,具有长期的增长确定性。

未来数年内,优质的IDC资产和服务商将成为资本追逐的焦点。在资产层面,位于核心区域、能够满足AI需求的高密度机房将变得极为稀缺;在服务商层面,真正理解AI需求、具备丰富AI客户服务经验、并且能进一步提供算力增值服务的IDC运营商,将在市场中脱颖而出。那些在AI浪潮中做好准备的企业和投资者,将在这场技术革命中抢占先机。

文中部分数据信息来源于世邦魏理仕、彭博、中金及上市公司财报。

270209/11

270209/11